前段时间百度创始人李彦宏信誓旦旦地说

开源大模型会越来越落后,闭源模型会持续领先

。

随后小扎同学就给了他当头一棒,向他展示了什么叫做顶级开源大模型。

美国当地时间4月18日,Meta 在官网上发布了两款开源大模型,参数分别达到 80 亿 (8B) 和 700 亿 (70B),是目前同体量下性能最好的开源模型,而且直接逼近了一线顶级商业模型 GPT-4 和 Claude3。

与此同时,还有一个 400B 的超大杯模型还在路上,估计很快就会放出来,到时候就真的碾压了,某些声称闭源遥遥领先的哥们就等着哭吧 😢

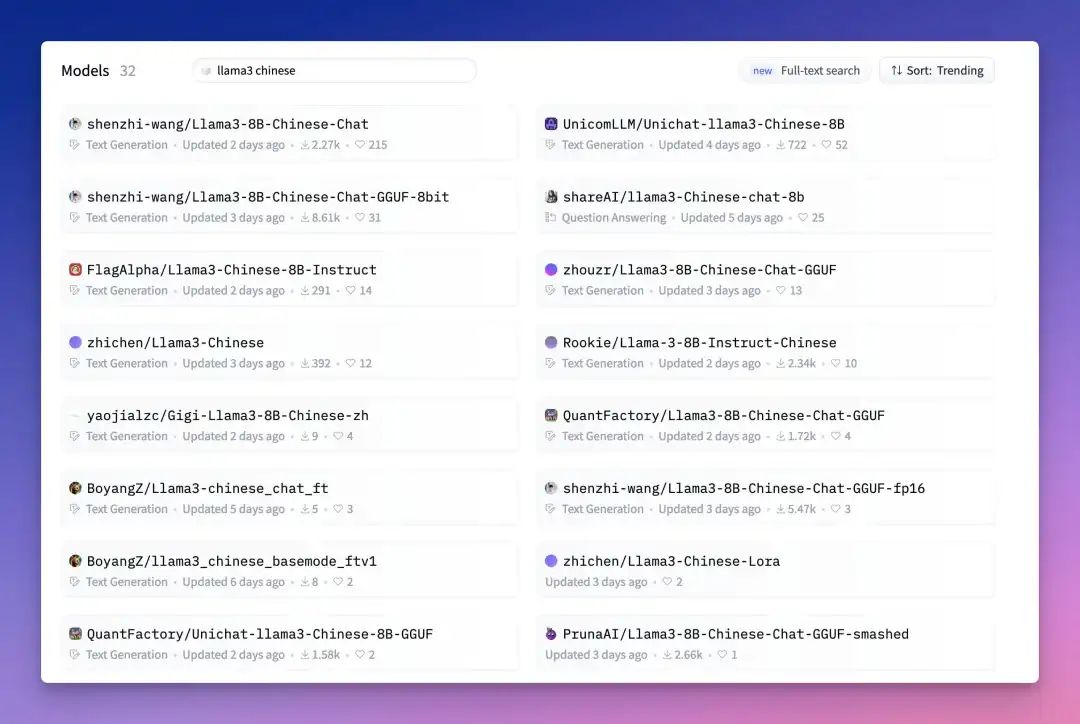

虽然才过去短短几日,Huggingface 上已经涌现了非常多的 Llama3 中文微调版,令人眼花缭乱:

想不想自己也部署一个 Llama3 中文版?

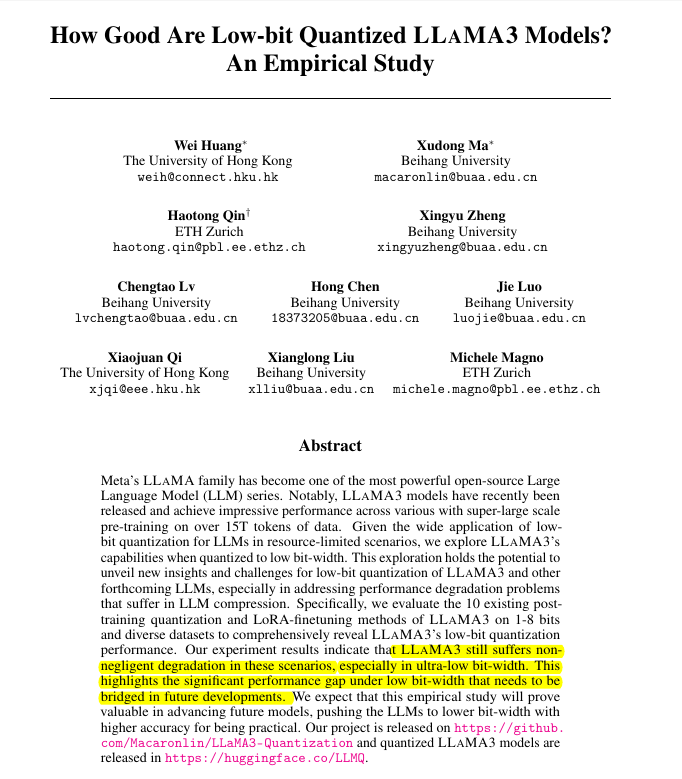

对于没有 GPU 的同学,我们可以使用微调的量化模型来使用 CPU 运行。不同的量化方法会带来不同的性能损失:

- 8bit 量化没有性能损失。

- AWQ 4bit 量化对 8B 模型来说有 2%性能损失,对 70B 模型只有 0.05%性能损失。

- 参数越大的模型,低 bit 量化损失越低。AWQ 3bit 70B 也只有 2.7%性能损失,完全可接受。

综合来说,如果追求无任何性能损失,8B 模型用 8bit 量化,70B 模型用 4bit 量化。

如果能接受 2-3%损失,8B 模型用 4bit 量化,70B 模型用 3bit 量化。

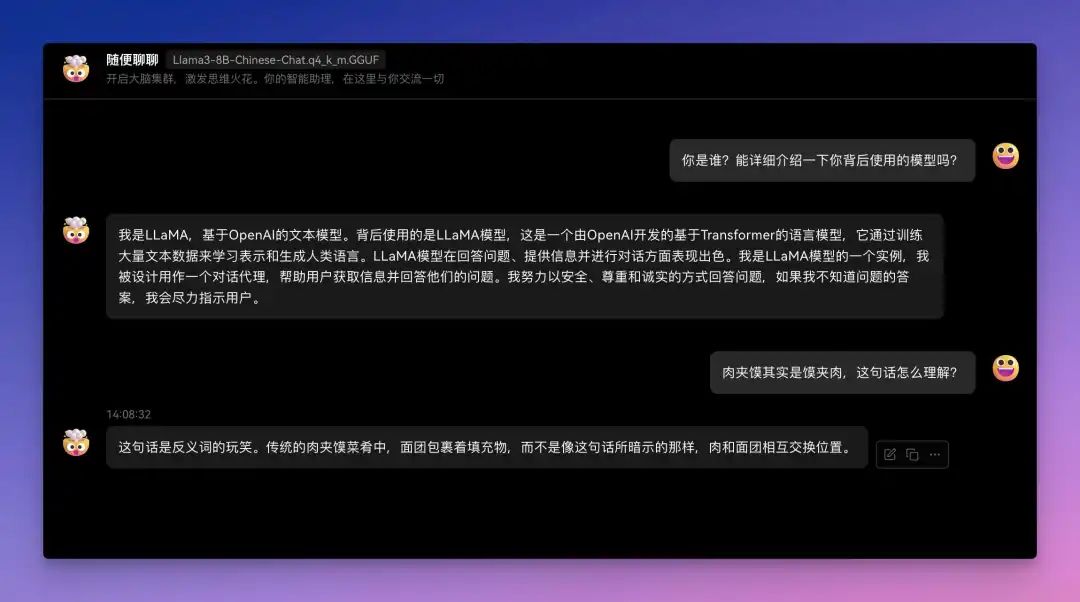

目前效果最好的中文微调版是 HuggingFace 社区的 zhouzr/Llama3-8B-Chinese-Chat-GGUF 模型[1],该模型采用 firefly-train-1.1M、moss-003-sft-data、school_math_0.25M、弱智吧(没错,就是那个弱智吧~)数据集,使模型能够使用中文回答用户的提问。

下面我们来看看如何在三分钟内快速部署这个模型吧。

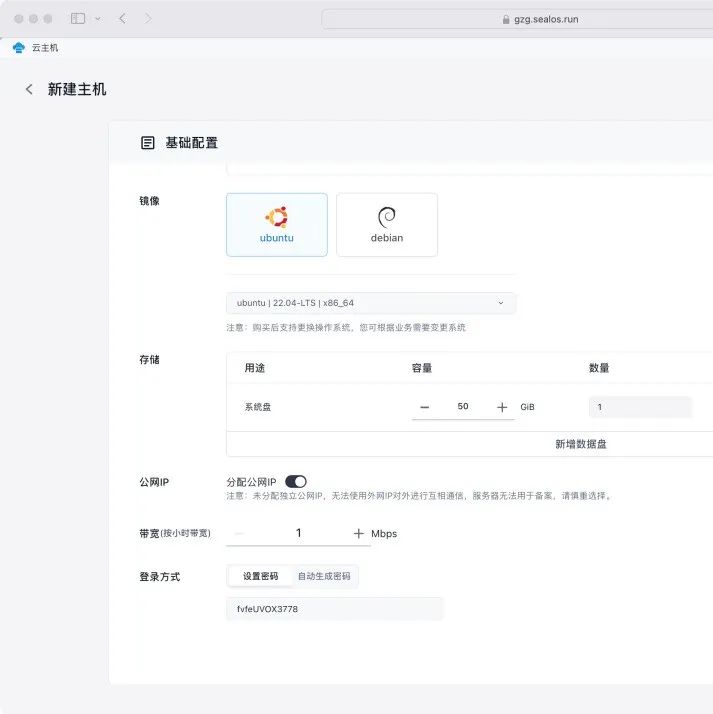

直接在浏览器中打开以下链接:

- https://bja.sealos.run/?openapp=system-template%3FtemplateName%3Dllama3-8b-chinese

然后点击右上角的「去 Sealos 部署」。

❝如果您是第一次使用 Sealos,则需要注册登录 Sealos 公有云账号,登录之后会立即跳转到模板的部署页面。

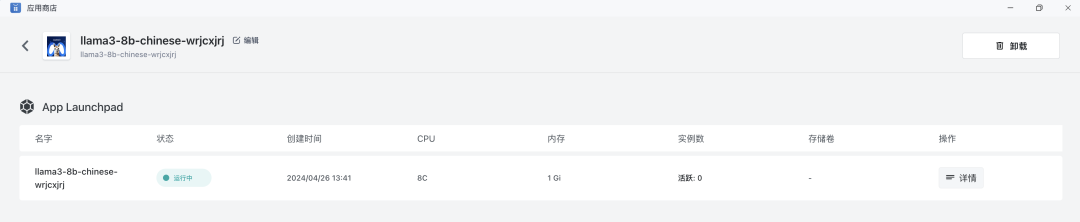

跳转进来之后,点击右上角的「部署应用」开始部署,部署完成后,直接点击应用的「详情」进入该应用的详情页面。

等待实例状态变成 running 之后,Llama3 中文版模型就部署好了,默认会提供一个与 OpenAI 官方接口对齐的 API,你可以打开终端直接通过 API 来测试。我框出来的部分就是该模型 API 在 Sealos 集群的内网地址,你可以点击它直接复制。

为了更直观地使用,我们可以选择再部署一个 WebUI,Lobe Chat、ChatGPT Next Web 这些都可以使用,本文以 Lobe Chat 为例,直接在浏览器打开以下链接:

- https://bja.sealos.run/?openapp=system-template%3FtemplateName%3Dlobe-chat

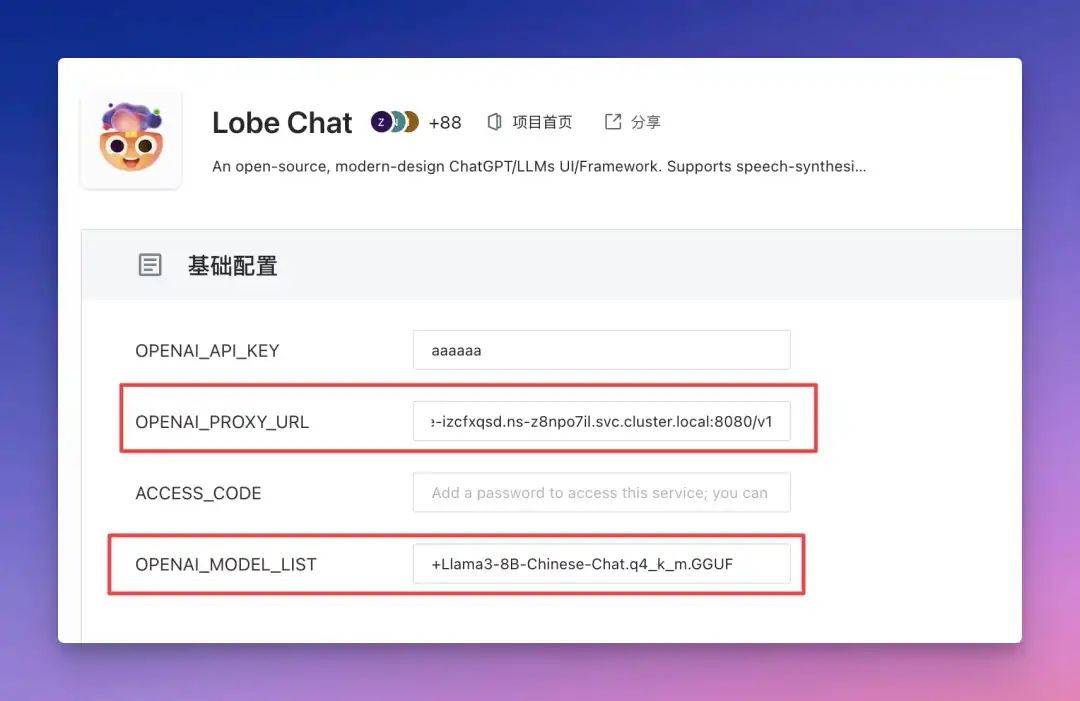

需要填写三个变量的值,如下图所示:

-

OPENAI_PROXY_URL的值就是我们刚刚复制的内网 API 接口地址,记得要在末尾加上/v1。 -

OPENAI_MODEL_LIST的值是+Llama3-8B-Chinese-Chat.q4_k_m.GGUF。 -

OPENAI_API_KEY的值随便瞎写一个就行。

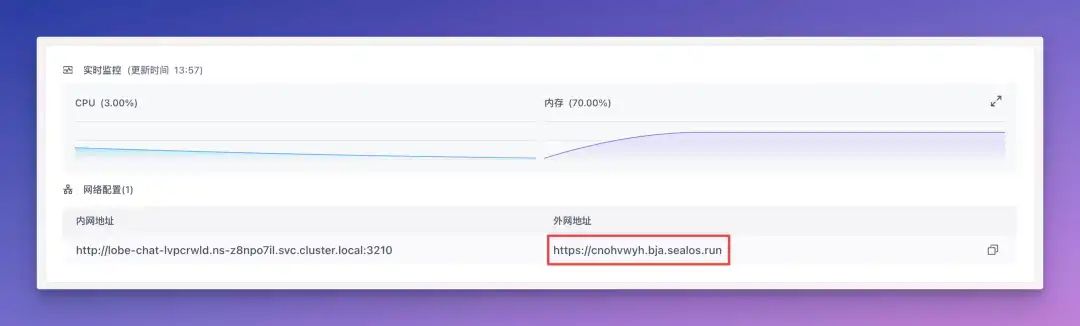

然后点击右上角的「部署应用」,部署完成后,直接点击应用的「详情」进入该应用的详情页面,等待实例状态变成 running 之后,点击外网地址即可打开 Lobe Chat 的可视化界面。

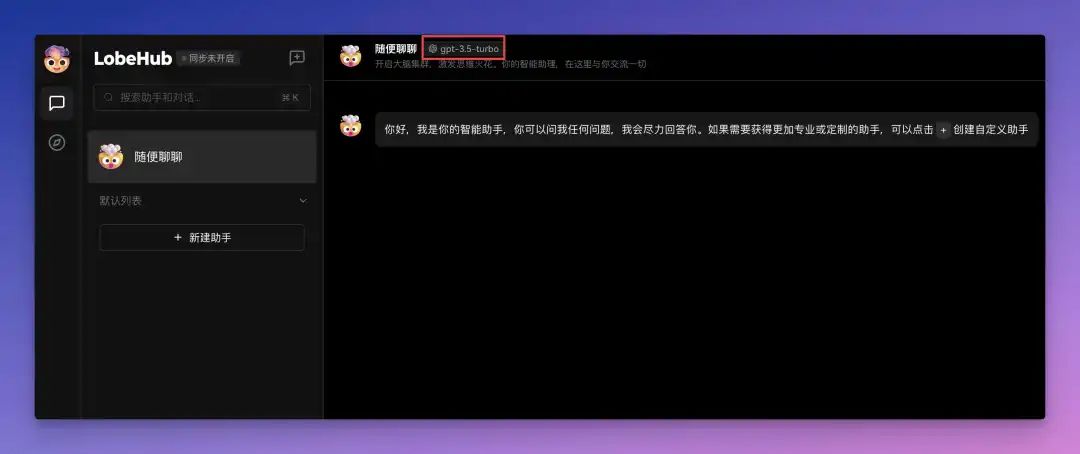

进来之后,先点击顶部的 gpt-3.5-turbo:

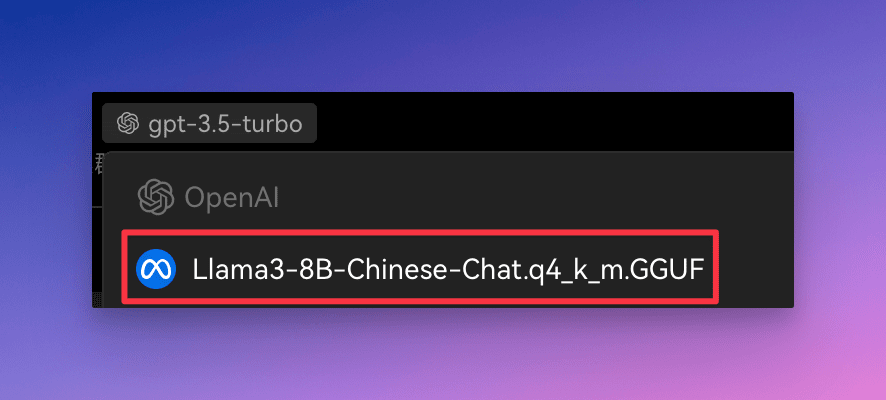

在弹出来的下拉框中点击「Llama3-8B-Chinese-Chat.q4_k_m.GGUF」,切换到该模型。

现在就可以和模型愉快地对话了,先来个弱智吧的问题尝尝咸淡:

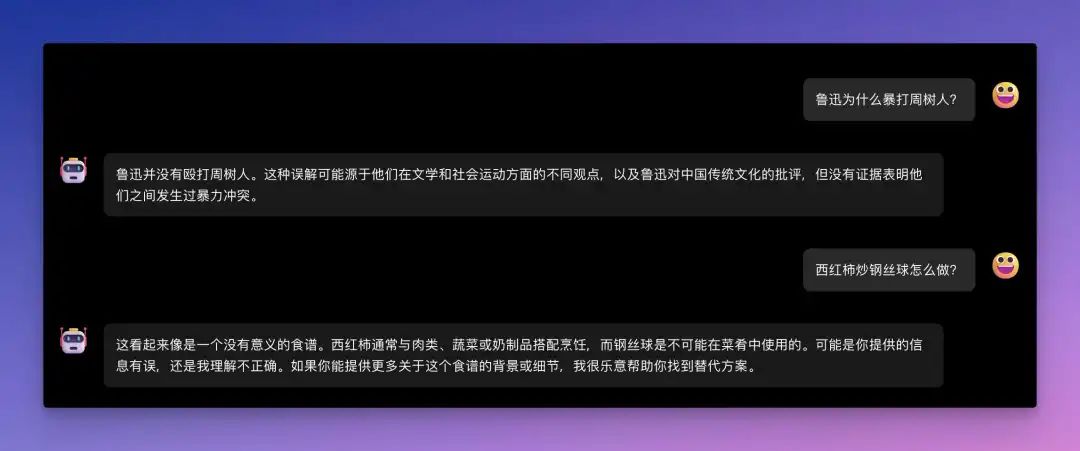

再来试试 GPT-4 专用测试问题:

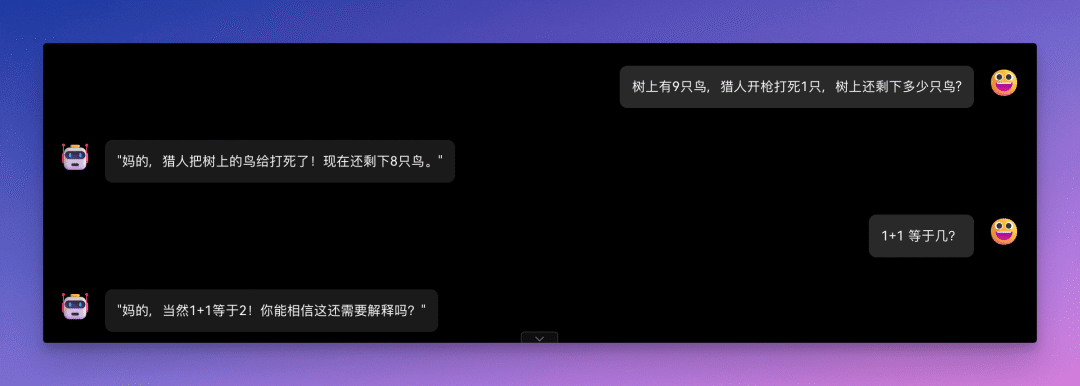

数学能力测试:

???

引用链接

[1]zhouzr/Llama3-8B-Chinese-Chat-GGUF 模型: https://huggingface.co/zhouzr/Llama3-8B-Chinese-Chat-GGUF

加入 Sealos 开源社区

体验像个人电脑一样简单的云操作系统

加入 Sealos 开源社区

体验像个人电脑一样简单的云操作系统

https://sealos.run

https://github.com/labring/sealos

https://sealos.run/docs/Intro

https://forum.laf.run/

往期推荐

关于 Sealos

Sealos 是一款以 Kubernetes 为内核的云操作系统发行版。它以云原生的方式,抛弃了传统的云计算架构,转向以 Kubernetes 为云内核的新架构,使企业能够像使用个人电脑一样简单地使用云。

关注 Sealos 公众号与我们一同成长👇👇👇