一、研究背景

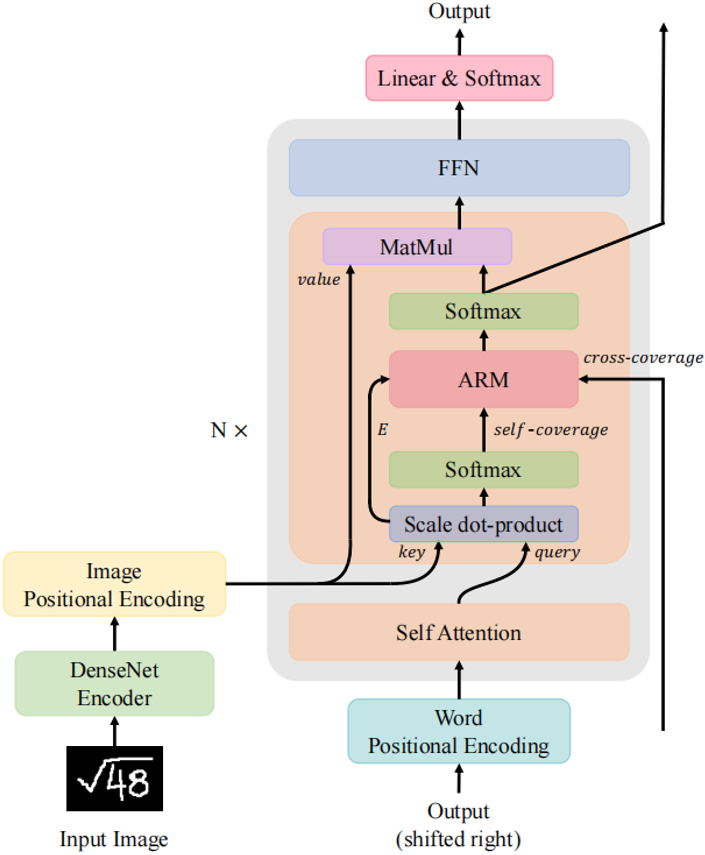

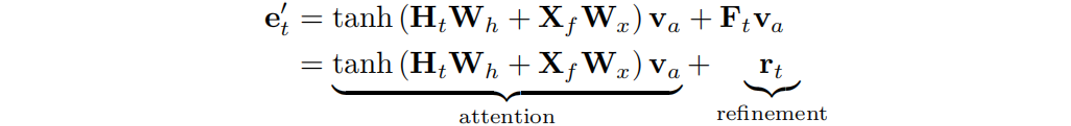

图1 本文提出的具有注意力精炼模块的Transformer模型

二、方法原理简述

。

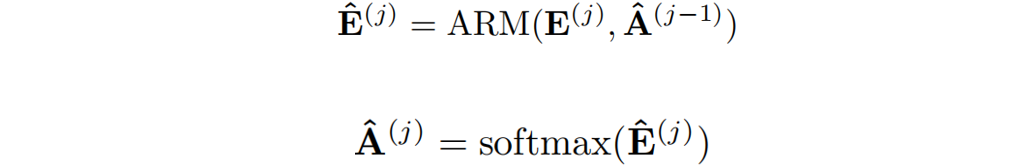

。 可表示为:

可表示为:

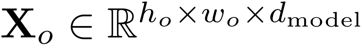

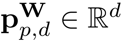

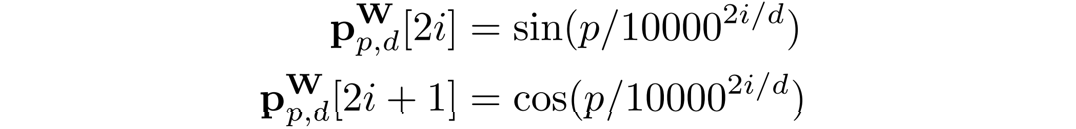

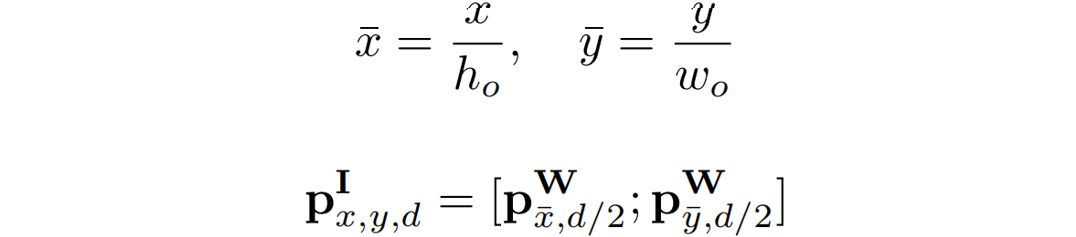

,编码维数为d,通过一维位置的拼接计算二维图像位置编码

,编码维数为d,通过一维位置的拼接计算二维图像位置编码 。

。

和

和 代表了输入图像特征的尺寸。

代表了输入图像特征的尺寸。 空间复杂度的覆盖矩阵

空间复杂度的覆盖矩阵 ,这样的大小是难以接受的。问题的瓶颈在于覆盖矩阵需要先与其他特征向量相加,再乘以向量

,这样的大小是难以接受的。问题的瓶颈在于覆盖矩阵需要先与其他特征向量相加,再乘以向量 。如果我们可以先将覆盖矩阵与

。如果我们可以先将覆盖矩阵与 相乘,再加上LuongAttention[4]的结果,空间复杂度将大大降低到

相乘,再加上LuongAttention[4]的结果,空间复杂度将大大降低到 。因此作者将注意力机制修改为:

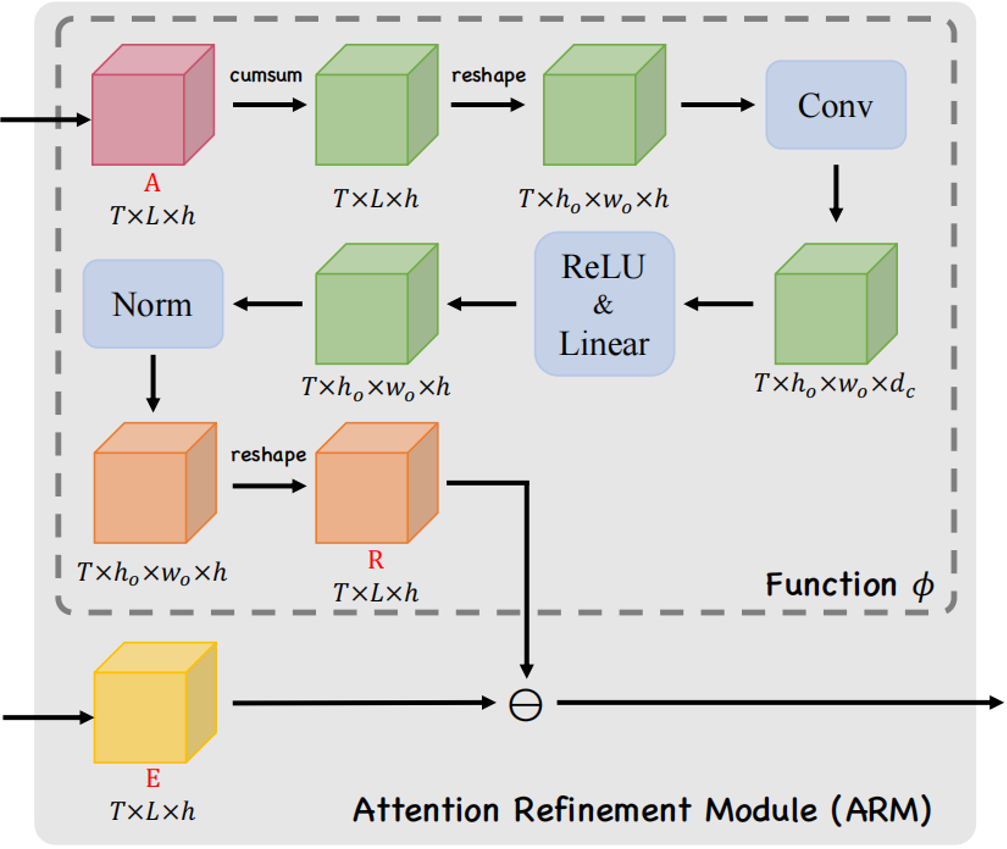

。因此作者将注意力机制修改为:

可分为注意项和精炼项

可分为注意项和精炼项 。需要注意的是,精炼项可以通过覆盖函数直接由累积

。需要注意的是,精炼项可以通过覆盖函数直接由累积 向量生成,从而避免了具有为维数为

向量生成,从而避免了具有为维数为 的中间项。作者将上式命名为注意力精炼框架。

的中间项。作者将上式命名为注意力精炼框架。

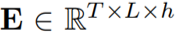

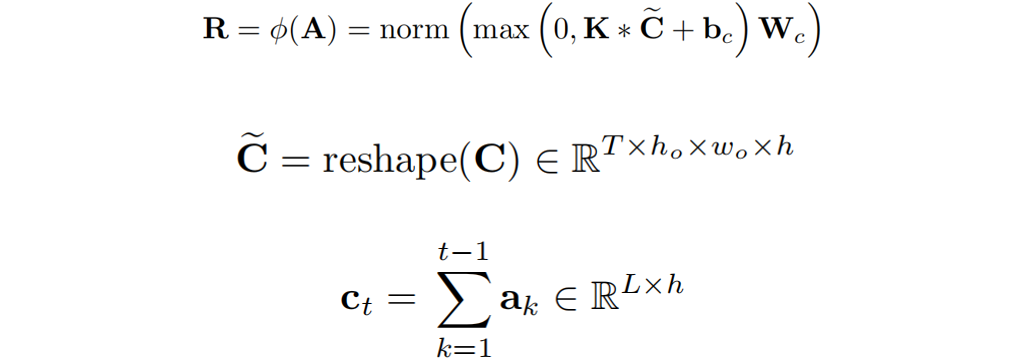

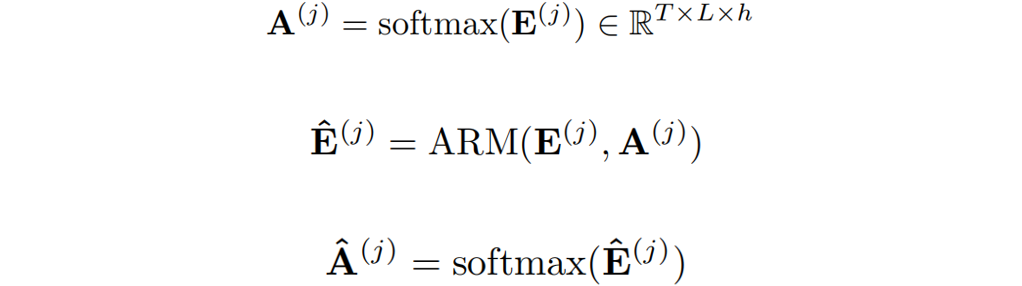

作为注意项,精炼项矩阵R需要从经过Softmax后的注意权值A中计算出来。作者使用了注意权值A来提供历史对齐信息,具体的选择会在下一小节介绍。

作为注意项,精炼项矩阵R需要从经过Softmax后的注意权值A中计算出来。作者使用了注意权值A来提供历史对齐信息,具体的选择会在下一小节介绍。 作为输入,输出为精炼矩阵

作为输入,输出为精炼矩阵 的函数

的函数 :

:

是在时间步

是在时间步 时的注意力权重。

时的注意力权重。 代表一个卷积核,*代表卷积操作。

代表一个卷积核,*代表卷积操作。 是一个偏置项,

是一个偏置项, 是一个线性投影矩阵。

是一个线性投影矩阵。 可以提取局部覆盖特征来检测已解析区域的边缘,并识别传入的未解析区域。最终,作者通过减去精炼项R来达到精炼注意力项E的目的。

可以提取局部覆盖特征来检测已解析区域的边缘,并识别传入的未解析区域。最终,作者通过减去精炼项R来达到精炼注意力项E的目的。 ,并对其进行精炼。

,并对其进行精炼。

代表了精炼后的点积结果。

代表了精炼后的点积结果。 代表在j层精炼后的注意力权重。

代表在j层精炼后的注意力权重。 之前

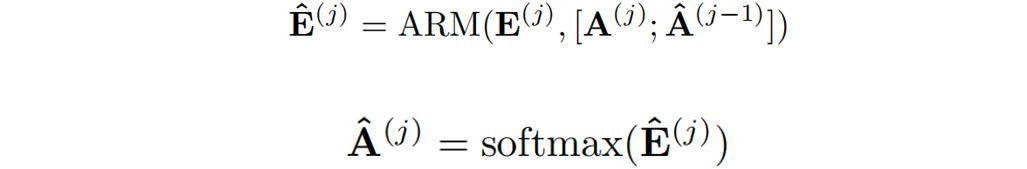

之前 层来精炼当前层的注意力项。

层来精炼当前层的注意力项。

其中 表示来自当前层的注意权重与来自前一层的精炼注意权重进行拼接。

表示来自当前层的注意权重与来自前一层的精炼注意权重进行拼接。

三、主要实验结果及可视化结果

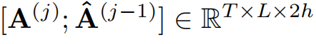

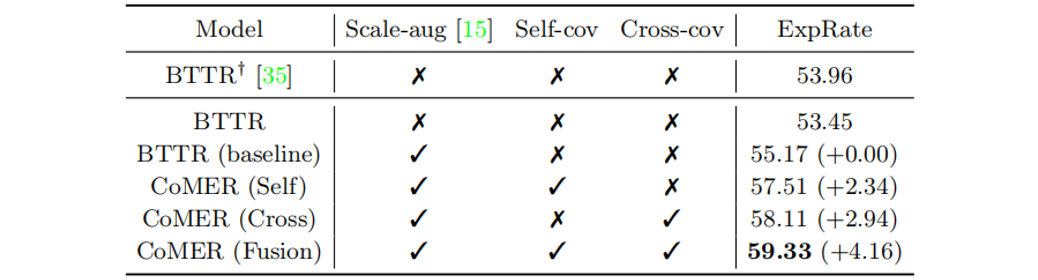

表1 与先前工作在CROHME数据集上的效果的比较

表2 各模块消融实验

在表2中,“Scale -aug”表示是否采用尺度增广[6]。“Self-cov”和“Cross-cov”分别表示是否使用自覆盖和交叉覆盖。与BTTR相比,采用ARM和覆盖机制的CoMER的性能有了明显的提高。

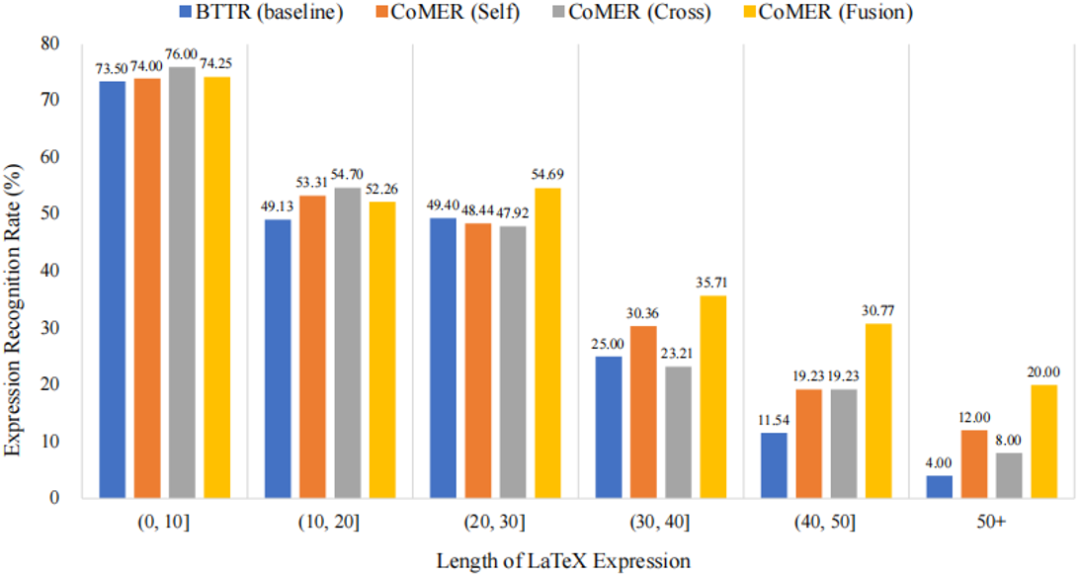

图3 不同算法在CROHME 2014数据集上不同长度正确率的对比

图3 不同算法在CROHME 2014数据集上不同长度正确率的对比 图4 公式图像识别中的精炼项R可视化。

图4 公式图像识别中的精炼项R可视化。如图4所示,作者将识别过程中的精炼项R可视化。可以看到,经过解析的区域颜色较深,这表明ARM将抑制这些解析区域的注意权重,鼓励模型关注未解析区域。可视化实验表明,作者提出的ARM可以有效地缓解覆盖不足的问题。

四、总结及讨论

作者受RNN中覆盖注意力的启发,提出将覆盖机制引入到Transformer解码器中。提出了一种新的注意精炼模块(ARM),使得在Transformer中进行注意力精炼的同时不损害其并行计算特性成为可能。同时还提出了自覆盖、交叉覆盖和融合覆盖的方法,利用来自当前层和前一层的过去对齐信息来优化注意权重。实验证明了作者提出的CoMER缓解了覆盖不足的问题,显著提高了长表达式的识别精度。作者认为其提出的注意精炼框架不仅适用于手写数学表达式识别。ARM可以帮助精炼注意权重,提高所有需要动态对齐的任务的对齐质量。为此,作者打算将解码器中的ARM扩展为一个通用框架,用于解决未来工作中的各种视觉和语言任务(例如,机器翻译、文本摘要、图像字幕)。

五、相关资源

CoMER: Modeling Coverage for Transformer-based Handwritten Mathematical Expression Recognition 论文地址: https://arxiv.org/pdf/2207.04410.pdf 代码地址:https://github.com/Green-Wood/CoMER When Counting Meets HMER: Counting-Aware Network for Handwritten Mathematical Expression Recognition 论文地址: https://arxiv.org/pdf/2207.11463.pdf 代码地址:https://github.com/LBH1024/CAN Syntax-Aware Network for Handwritten Mathematical Expression Recognition 论文地址:https://openaccess.thecvf.com/content/CVPR2022/papers/Yuan_Syntax-Aware_Network_for_Handwritten_Mathematical_Expression_Recognition_CVPR_2022_paper.pdf 代码地址:https://github.com/tal-tech/SAN Handwritten Mathematical Expression Recognition via Attention Aggregation based Bi-directional Mutual Learning 论文地址: https://ojs.aaai.org/index.php/AAAI/article/download/19885/19644 代码地址:https://github.com/XH-B/ABM Handwritten Mathematical Expression Recognition with Bidirectionally Trained Transformer

论文地址: https://arxiv.org/pdf/2105.02412.pdf

代码地址:https://github.com/Green-Wood/BTTR

参考文献

原文作者: Wenqi Zhao, Liangcai Gao

撰稿:杨文韬

编排:高 学

审校:殷 飞

发布:金连文

免责声明:(1)本文仅代表撰稿者观点,撰稿者不一定是原文作者,其个人理解及总结不一定准确及全面,论文完整思想及论点应以原论文为准。(2)本文观点不代表本公众号立场。