别污了我的眼!约会App利用AI给裸照打码,别人发的色情图片你可选择拒看

大数据文摘出品

作为探探的祖先,Tinder一直饱受国外年轻人的喜爱。

Tinder的前市场副总裁Whitney Wolfe Herd作为一名女性高管,在离开Tinder之后,决定开发一款更加面向女性用户的类似的社交软件。

于是,Bumble应运而生,和Tinder一样,潜在的匹配对象会显示给用户,用户可以“向左滑动”选择拒绝,或者“向右滑动”表示感兴趣,双方都选择“向右滑动”后,就会产生配对。

只不过,在Bumble中,异性场景下,只允许女性用户向匹配的男性用户发送第一句话,而在同性恋场景下,任何一方都可以先发送信息。

Wolfe Herd曾把Bumble描述为一款“女权主义约会应用”,因此,为了进一步保护女性用户的权益,Bumble甚至用上了AI。

据Bumble官网介绍,他们开发了Private Detector人工智能功能,来应对主动发送色情图片的行为。

保护你的眼睛,收到色情图片,可以选择拒收

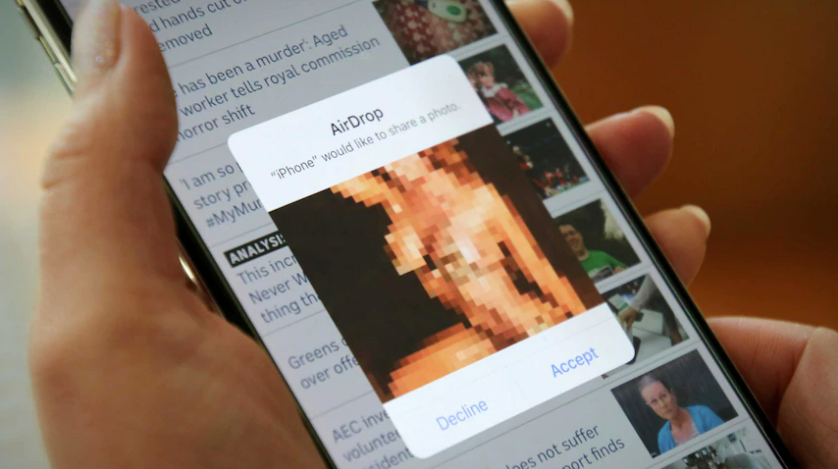

Private Detector的工作原理是,当你收到一个疑似为裸体照片的图像时,程序会自动给这个图像打码。

之后,用户将收到通知,并有权决定是否查看或阻止图像(用户也可以很方便地向Bumble报告)。

在网络上主动发送色情图片,这一行为被定义为“网络闪光”(Cyberflashing),深受一些用户的厌恶。

Bumble基于EfficientNet-V2开发了Private Detector来应对“网络闪光”,EfficientNet-V2是一款非常经典的图像分类模型。

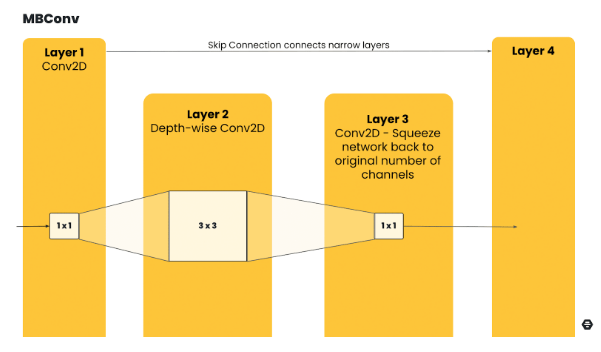

Bumble认为,EfficientNet-V2是一款具有更快的训练速度和整体更好的参数效率的卷积网络,它结合了更好的设计架构和机制,像MBConv (利用1 × 1卷积来扩大空间和深度卷积以减少整体参数的数量)和FusedMBConv这样的卷积层来共同优化训练速度和参数效率。

目前,该模型已经在Bumble的数据中心进行了训练,对数据集、网络和超参数进行了连续的优化。

数据来源——自己家的图片

Bumble认为,尽管在我们的应用程序上发送色情图片的用户数量可以忽略不计——只有0.1% ——但庞大的用户规模使得Bumble能够收集业内最好的淫秽和非淫秽图片数据集,以达到最佳的训练效果。

我们的Private Detector使用非常大容量的数据集进行训练,仔细选择阴性样本(不包含任何淫秽内容的样本) ,以便更好地反映边缘情况和人体其他部位(如腿部、手臂) ,以免错误标记。

Private Detector还通过迭代地向训练数据集中添加样本,以反映实际用户的行为以及测试错误分类,这被证明是一项行之有效的技术。

在不同条件下的表现时(包括线下和线上) ,Private Detector达到了世界级的表现,准确率超过了98% 。

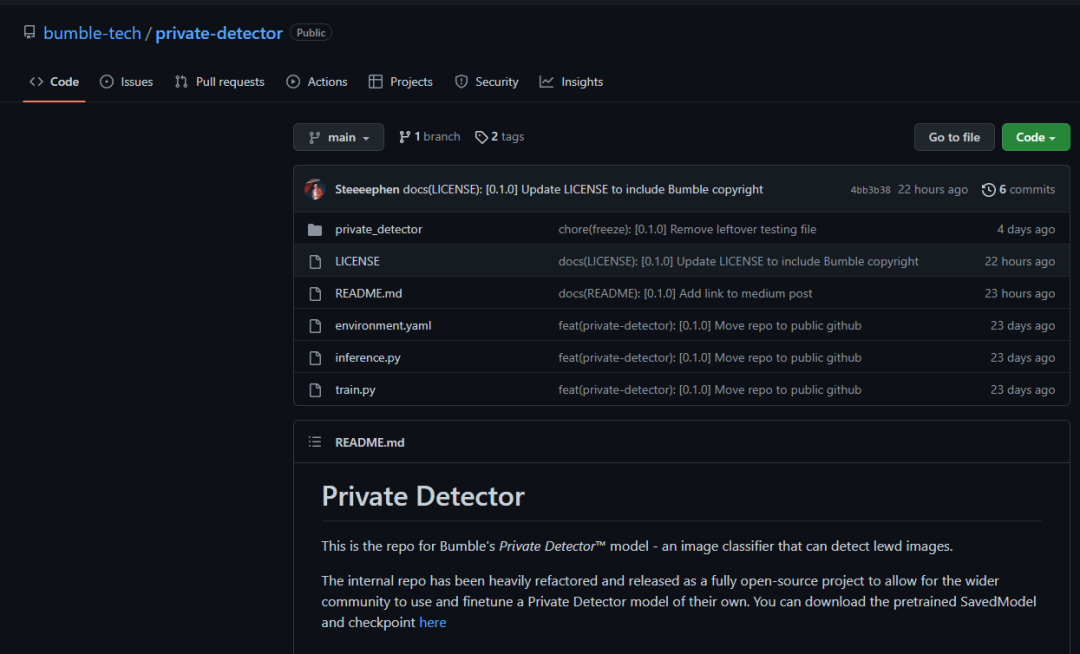

Bumble还在Github.com上发布了Private Detector的源代码,还有一个现成的SavedModel来部署模型(使用TensorFlow Serving) ,以及一个检查点,可以用额外的图像对模型进行微调,提高对特定用例重要的样本的性能。

为此,Bumble的数据科学团队已经撰写了一份白皮书,解释了Private Detector的技术,并在GitHub上提供了一个开源版本。