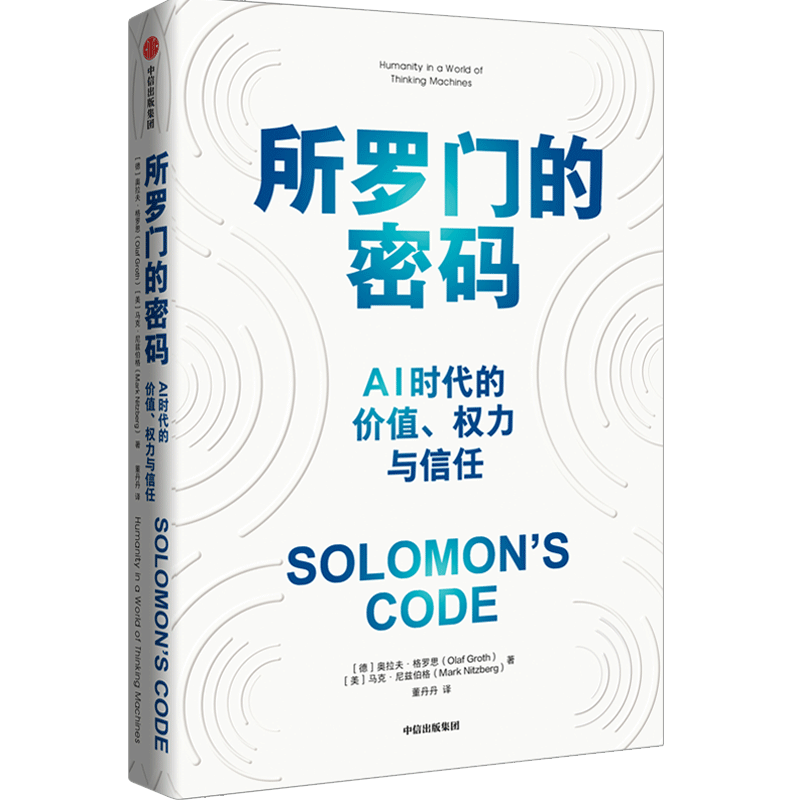

所罗门的密码:如何避免权力和信任被滥用|硅兔赠书福利

硅兔赛跑

共 3103字,需浏览 7分钟

· 2022-07-04

📖硅兔福利来袭:

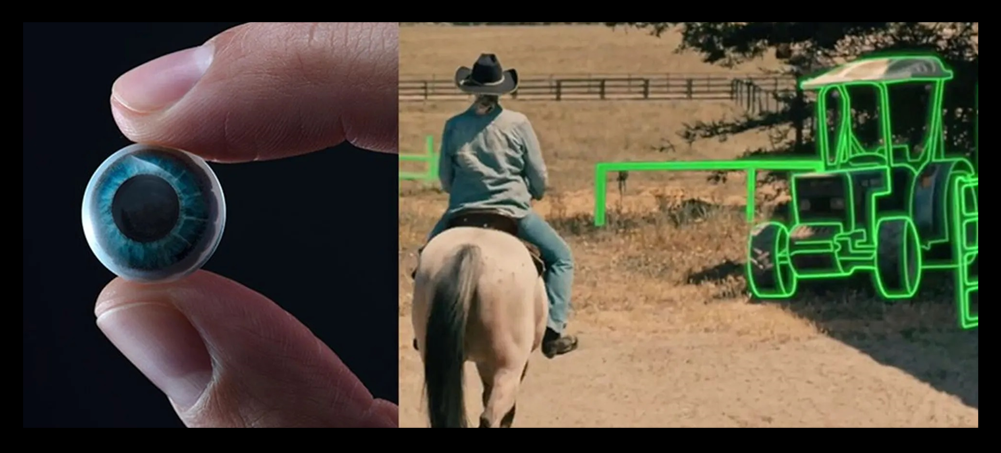

科技是一把双刃剑,你认为人类与AI如何共生共存?

我们将结合点赞数和留言质量,抽取3名幸运读者,送出《所罗门的密码》一本。

👇评论区留下你的想法参与活动吧~

👇👇👇

评论

共 3103字,需浏览 7分钟

· 2022-07-04

📖硅兔福利来袭:

科技是一把双刃剑,你认为人类与AI如何共生共存?

我们将结合点赞数和留言质量,抽取3名幸运读者,送出《所罗门的密码》一本。

👇评论区留下你的想法参与活动吧~