来源:专知 本文约1500字,建议阅读5分钟 这本书旨在为您提供实现和部署最先进的可解释性技术的实用技巧。

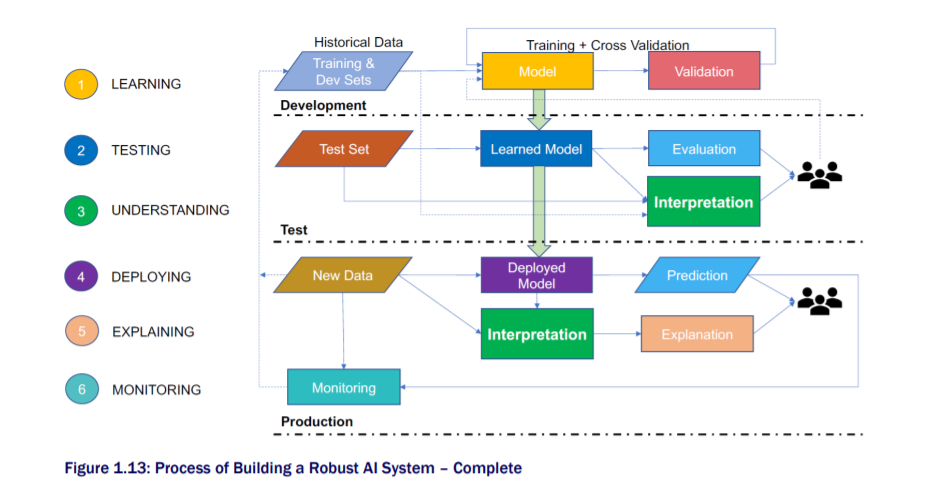

第一章涵盖了不同类型的AI系统,定义了可解释性及其重要性,讨论了白盒和黑盒模型,并解释了如何构建可解释性AI系统。 第二章介绍了白盒模型以及如何解释它们,特别关注线性回归、决策树和广义可加模型(GAMs)。

第3章介绍了一种被称为树集合的黑盒模型,以及如何使用全局范围内的事后模型不可知方法来解释它们,例如部分依赖图(PDP)和特征交互图。 第4章涵盖深度神经网络,以及如何使用局部范围内的事后模型不可知性方法来解释它们,如局部可解释模型不可知性解释(LIME), SHapley加性解释(SHAP)和锚定。 第5章涵盖了卷积神经网络,以及如何使用显著性映射来可视化模型的重点,特别是关注诸如梯度、引导反向传播、梯度加权类激活映射(Grad-CAM)、引导Grad-CAM和平滑梯度(SmoothGrad)等技术。

第6章涵盖了卷积神经网络,以及如何解剖它们,以理解由神经网络中的中间或隐藏层学习的数据表示。 第7章涵盖了语言模型,以及如何使用主成分分析(PCA)和t分布随机邻居嵌入(t-SNE)等技术来可视化学习的高维表示。

第8章涵盖了公平的各种定义,以及检查模型是否有偏差的方法。它还讨论了减少偏差的技术,以及使用数据表记录数据集的标准化方法,这将有助于提高与AI系统的利益相关者和用户的透明度和问责性。 第9章通过理解如何构建这样的系统,为可解释的AI铺平了道路,还包括使用反事实的例子进行对比解释。