极市导读

图像级对比表征学习已经被证明是处理迁移学习问题一种非常有效的通用模式,但如果我们对某一特定的下游任务感兴趣,这种对于迁移学习的通用性就牺牲了特殊性。本文提出了自监督的上下游任务应该对齐的原则,认为不对齐是一种次优的方式。>>加入极市CV技术交流群,走在计算机视觉的最前沿

图像级对比表征学习已经被证明是处理迁移学习问题一种非常有效的通用模式,但如果我们对某一特定的下游任务感兴趣,这种对于迁移学习的通用性就牺牲了特殊性。本文提出了自监督[1]的上下游任务应该对齐的原则,认为不对齐是一种次优的方式。

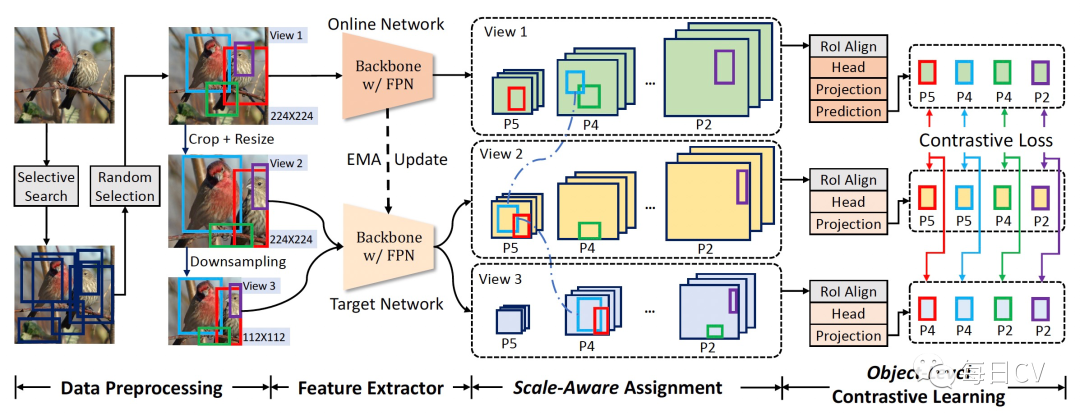

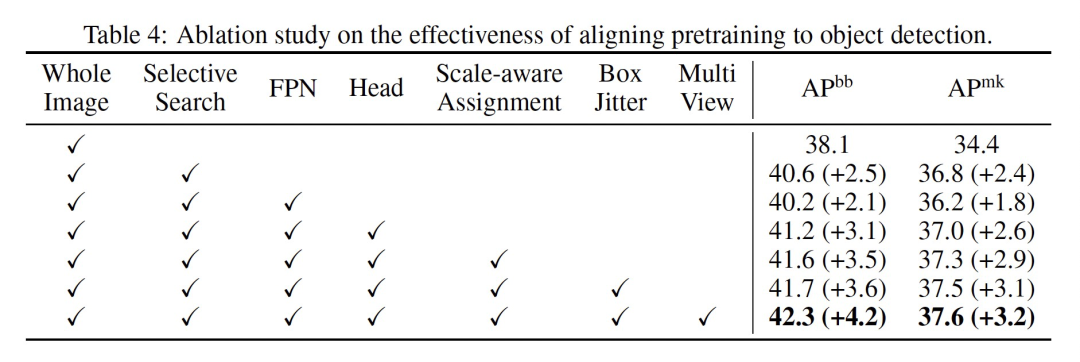

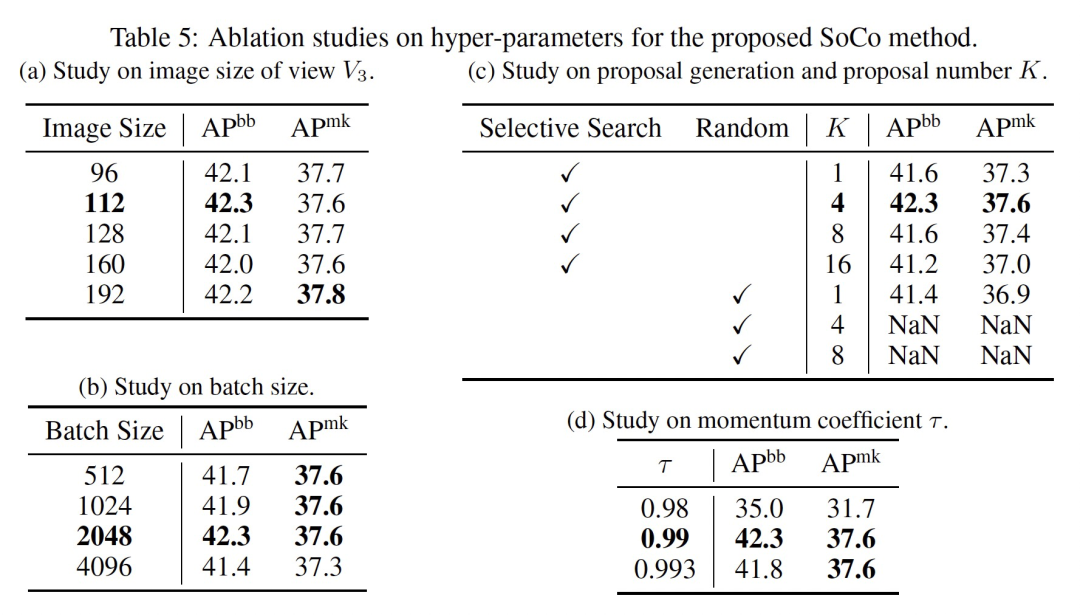

本文遵循这一设计原则专门为目标检测任务设计了一种预训练方法,通过三个方面来实现目标检测上下游任务的对齐:

1)通过selective search bounding boxes方法获得的候选目标来实现目标级表征学习;

2)预训练的网络结构中包含目标检测所使用的相同的专用模块,如FPN;

3)所提预训练方法具备目标检测所需的属性,如目标级平移不变性和尺度不变性。

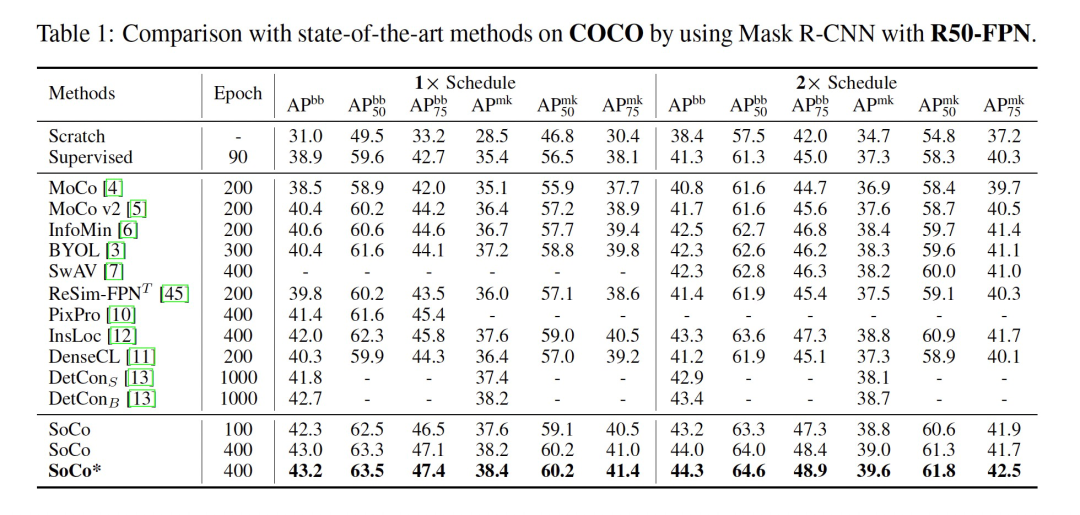

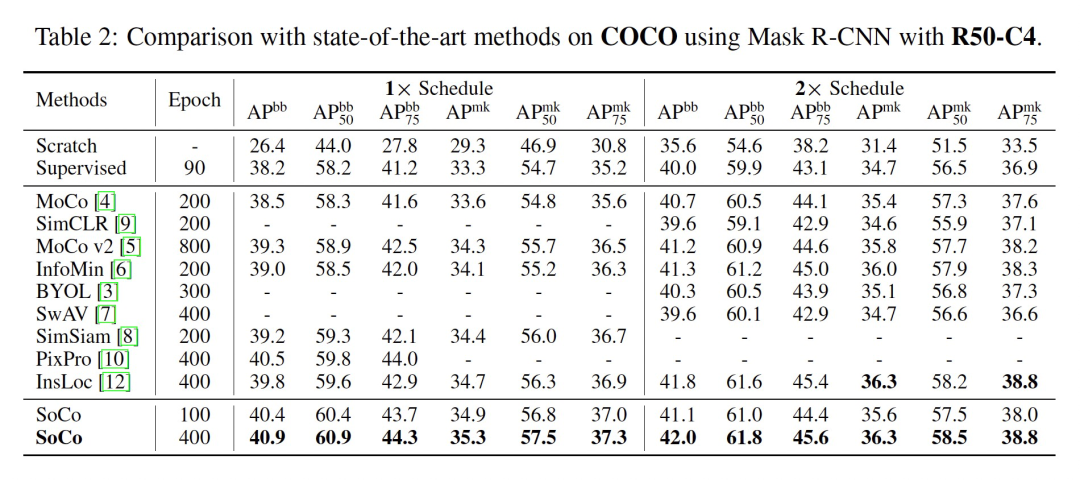

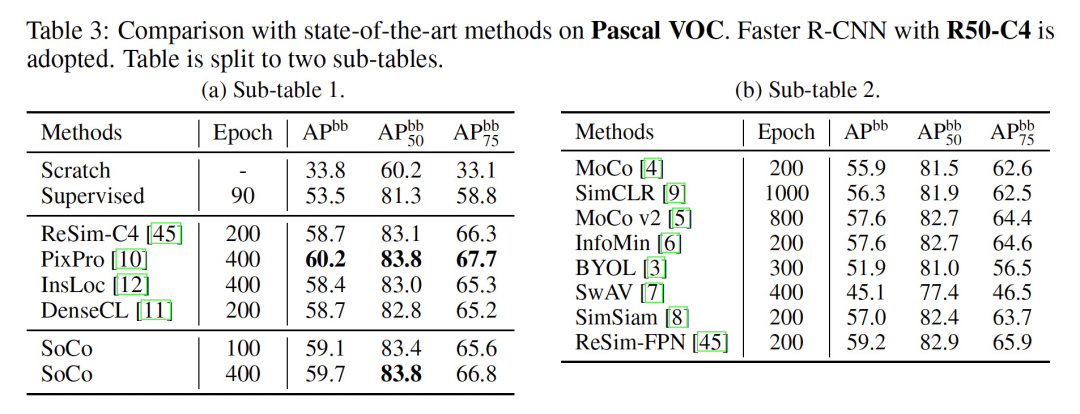

本文将所提方法命名为SoCo(Selective Object COntrastive learning),使用Mask R-CNN框架在COCO检测任务上取得了SOTA的迁移表现。

journal: NeurIPS 2021 Spotlight

paper: https://arxiv.org/abs/2106.02637

code: https://github.com/hologerry/SoCo

注[1]:自监督(self-supervised learning)属于无监督(unsupervised learning)的一种学习范式

一、SoCo方法动机

预训练(pretraining)和 微调(finetuning)已经是计算机视觉中训练深度神经网络的主导范式,下游任务通常利用在大型标记数据集(如ImageNet)上学习的预训练权重进行初始化,因此有监督的ImageNet预训练在整个领域中非常普遍。最近自监督预训练已经取得了相当大的进展,减轻了对标记数据的依赖。这些方法旨在通过图像级的上游任务(如实例识别)来学习各种下游任务的通用视觉表示。最近的一些工作观察到,图像级表示对于密集预测任务(如目标检测和语义分割)是次优的。一个潜在的原因是,图像级预训练可能过度拟合了整体表示,无法学习图像分类之外的重要属性。

本文旨在实现一个与目标检测相一致的自监督预训练。在目标检测中,边界框被广泛采用作为目标的表示,目标检测的平移不变性和尺度不变性通过边界框的位置和大小来反映。图像级预训练和目标检测的目标级边界框之间存在明显的表示差距。

二、SoCo方法细节

三、实验

四、总结

五、点评

如果觉得有用,就请分享到朋友圈吧!

公众号后台回复“88”获取严彬:STARK-

基于时空Transformer的视觉目标跟踪PPT下载

# CV内推社群邀请函 #

备注:备注:姓名-学校/公司-内推(小极-极视角-内推)

即可申请加入极市内推技术交流群,获得最新大厂内推和面经干货

每月大咖直播分享、真实项目需求对接、求职内推、算法竞赛、干货资讯汇总、与 10000+来自港科大、北大、清华、中科院、CMU、腾讯、百度等名校名企视觉开发者互动交流~