点击上方“程序员大白”,选择“星标”公众号

重磅干货,第一时间送达

来自|知乎 编辑|深度学习与计算机视觉

声明|仅做学术分享,侵删

作者:mileistone

https://www.zhihu.com/question/40577663/answer/309571753

因为我对计算机视觉比较熟,就从计算机视觉的角度说一下自己对深度学习瓶颈的看法。

大多数文章的idea都是靠直觉提出来的,背后的很少有理论支撑。通过实验验证有效的idea,不一定是最优方向。就如同最优化问题中的sgd一样,每一个step都是最优,但从全局来看,却不是最优。

因为深度学习本身缺乏理论,深度学习理论是一块难啃的骨头,深度学习框架越来越傻瓜化,各种模型网上都有开源实现,现在业内很多人都是把深度学习当乐高用。

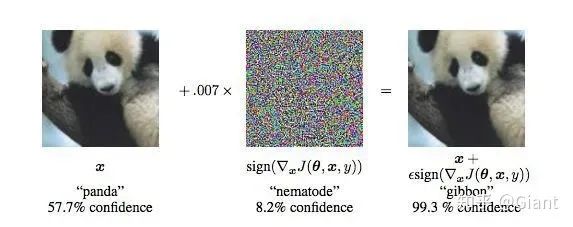

我认为对抗样本虽然是深度学习的问题,但并不是深度学习的瓶颈。机器学习中也有对抗样本,机器学习相比深度学习有着更多的理论支撑,依然没能把对抗样本的问题解决。

https://www.zhihu.com/question/40577663/answer/413331053

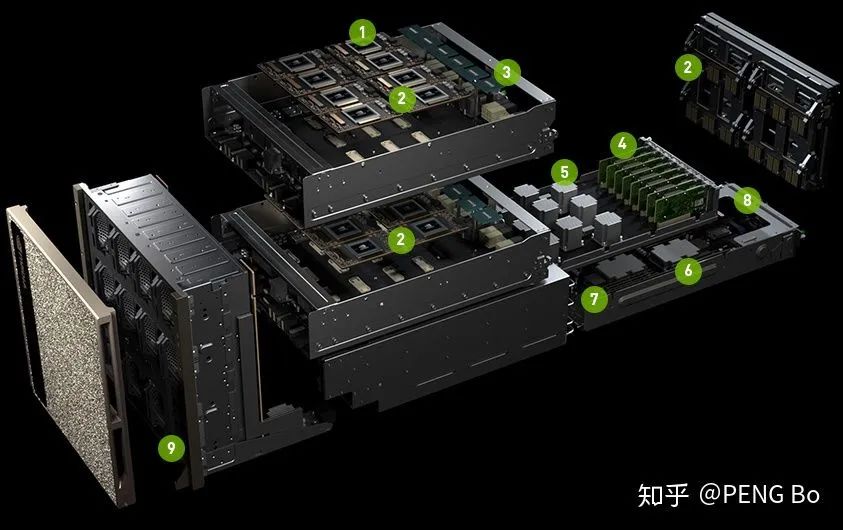

AI芯片花了这么大力气还是带宽受限,那么人脑为何没有受限于带宽?

人脑的并行化做得太好了,因此神经元之间只需要kB级的带宽。值得AI芯片和算法研究者学习。 人脑的学习方法比BP粗糙得多,所以才能这样大规模并行化。 人脑的学习方法是去中心化的,个人认为,更接近 energy-based 的方法。 人脑的其它特点,用现在的迁移学习+多任务学习+持续学习已经可以模仿。 人脑还会用语言辅助思考。如果没有语言,人脑也很难快速学会复杂的事情。

https://www.zhihu.com/question/40577663/answer/1974793135

1. 对标注数据依赖性大

2. 模型具有领域依赖性,难以直接迁移

3. 巨无霸模型对资源要求高

4. 模型欠缺常识和推理能力

5. 应用场景有限

6. 缺少高效的超参数自动搜索方案

7. 部分paper仅以比赛SOTA为导向

8. 可解释性不强

https://www.zhihu.com/question/40577663/answer/224699031

比如特征结构难以改变。对于数据的格式(尺寸、长短、颜色通道、文本词典格式等等)要求苛刻。训练好的feature extractor不是那么容易迁移到其他task上。 它非常的不稳定。例如在NLP的任务中,做文本生成(QA)、图像标注之类的工作时,有时候生成的内容让你拍案叫绝。但经常也会是匪夷所思。所以它的不可控性导致在工程应用中不是很广泛。很多牺牲recall保precision的应用都没法用深度学习去搞,否则容易出危险。相比之下rule based的方法要可靠得多。至少出问题了能debug一下。

它难以hotfix,出了问题基本靠重新调参训练。在应用过程中会遇上很多潜在困难。

深度模型的优化过于依赖个人经验。世界三大玄学:西方占星、东方周易、深度学习。

模型结构越来越复杂,不同系统之间越来越难以整合。就好像一直在培养超级士兵,但他们之间语言不通,没法组成一个超级军队。

敏感信息问题。训练模型使用的数据如果没有脱敏,是有可能通过一些方法把敏感信息给试出来。

攻击问题。现在已经证实对抗样本(Adversarial Sample)的存在。创建一些对抗样本能直接干掉现有的算法。不过感觉对抗样本的生成是由于特征抽取并没有学习到数据的流型特征而引发的。或者说,一定程度的overfit带来了这个问题,

不过目前来说最大的问题还是对海量数据的需求。由于需要学习真实分布,而我们的数据仅仅是从真实分布中采样得到的一小部分。想要让模型真的逼近真实分布,那就要尽可能多的数据。数据量需求上来了,问题有很多:数据从哪来?数据存在哪?如何洗数据?谁来标数据?如何在大量数据上训练?如何在成本(设备、数据)和效果之间trade off?

由第8条扩展。需要海量数据的深度学习真的就是“人工智能”吗?反正我是不信。人脑可以用有限的知识归纳,而非只是用人为设计的指导方针来指挥机器学习到特征空间的分布。所以真正的人工智能,对数据和运算的需求应该并没有那么大!(这条其实也是机器学习的问题)

https://www.zhihu.com/question/40577663/answer/311095389

https://www.zhihu.com/question/40577663/answer/224656397

图像分类问题。此时x一般就是一个宽度*高度*通道数的图像数值矩阵,y就是分类的类别。 语音识别问题。x为语音采样信号,y为语音对应的文字。 机器翻译。x就是源语言的句子,y就是目标语言的句子。

模型容量大,参数多 端到端(end-to-end)

一、训练f的效率还不算高

二、拟合得到的f本身的不可靠性

三、f可以实现“强人工智能”吗

https://www.zhihu.com/question/40577663/answer/225319588

https://www.zhihu.com/question/40577663/answer/224756448

1.end-to-end training

2.universal approximation

缺点是对其中间拟合过程我们几乎没有任何control,所有我们想让其学习到的东西只能通过大量的数据,更复杂的网络(inception module, more layers),限定更多constraint(dropout, regularization),期望它最后学习到了等同于我们认知的判断。

推荐阅读

关于程序员大白

程序员大白是一群哈工大,东北大学,西湖大学和上海交通大学的硕士博士运营维护的号,大家乐于分享高质量文章,喜欢总结知识,欢迎关注[程序员大白],大家一起学习进步!