一、写在前面

二、研究动机与发现

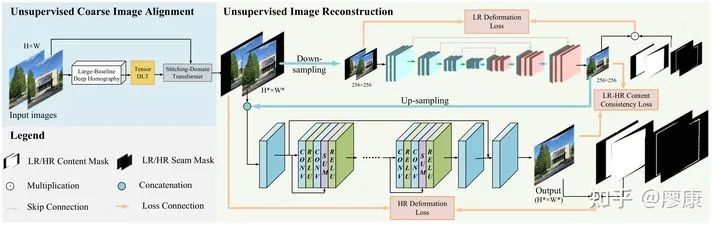

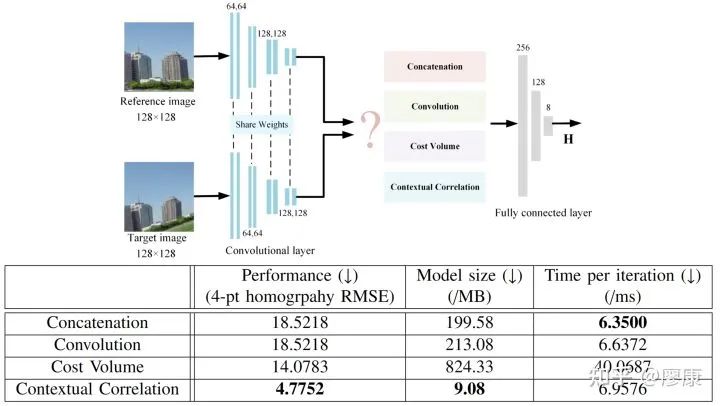

三、无监督图像拼接

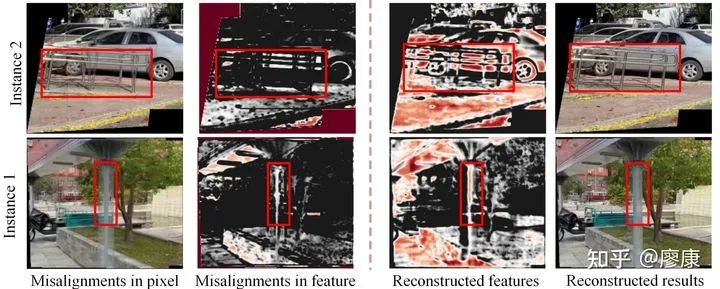

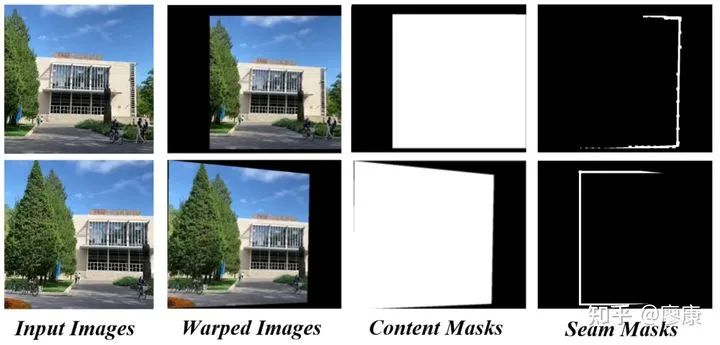

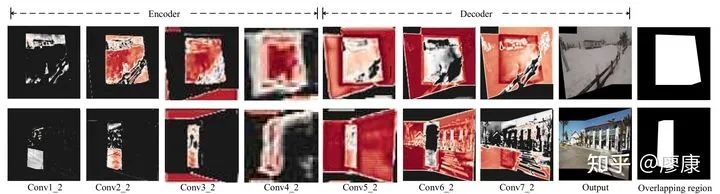

在低分辨率的重建分支中,约束重建拼接图的特征应该尽可能接近warp过后的图像特征。由此,我们提出了一个内容约束和一个缝隙约束来引导重建过程的学习方式。对于内容约束,我们约束拼接图的Content Masks(上图第3列)部分需要尽可能接近warped images的特征(VGG-19高层特征);对于缝隙约束,我们要求拼接图的Seam Masks(上图第4列)部分需要尽可能接近warped images的像素值。当前低分辨率分支重建的过程可视化如下图:网络会优先在encoder阶段重建重叠区域的特征,然后在decoder阶段恢复非重叠区域,最后重建出像素级的拼接图。

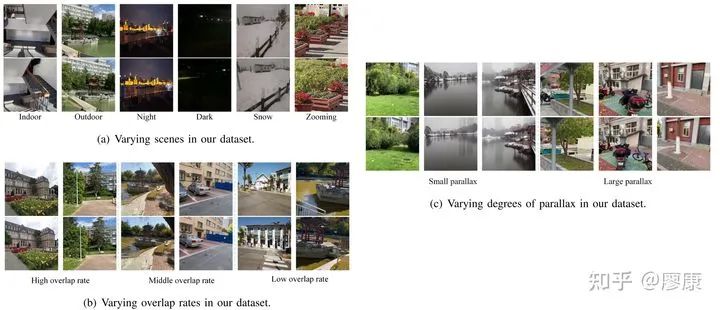

四、数据集

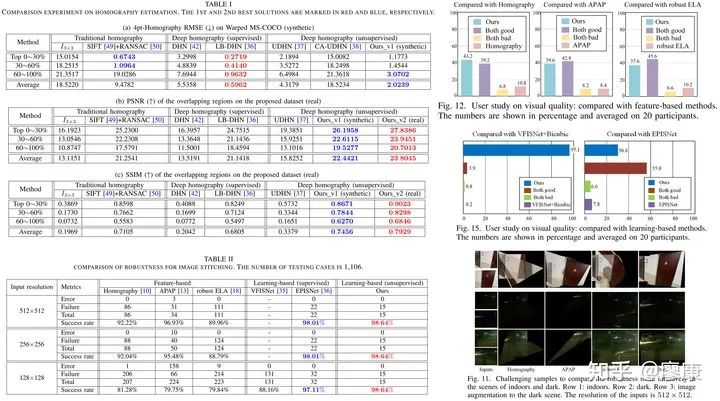

五、实验

六、一些思考及开放问题

重磅!3DCVer-学术论文写作投稿 交流群已成立

扫码添加小助手微信,可申请加入3D视觉工坊-学术论文写作与投稿 微信交流群,旨在交流顶会、顶刊、SCI、EI等写作与投稿事宜。

同时也可申请加入我们的细分方向交流群,目前主要有3D视觉、CV&深度学习、SLAM、三维重建、点云后处理、自动驾驶、多传感器融合、CV入门、三维测量、VR/AR、3D人脸识别、医疗影像、缺陷检测、行人重识别、目标跟踪、视觉产品落地、视觉竞赛、车牌识别、硬件选型、学术交流、求职交流、ORB-SLAM系列源码交流、深度估计等微信群。

一定要备注:研究方向+学校/公司+昵称,例如:”3D视觉 + 上海交大 + 静静“。请按照格式备注,可快速被通过且邀请进群。原创投稿也请联系。

▲长按加微信群或投稿

▲长按关注公众号

▲长按关注公众号

3D视觉从入门到精通知识星球:针对3D视觉领域的视频课程(三维重建系列、三维点云系列、结构光系列、手眼标定、相机标定、orb-slam3等视频课程)、知识点汇总、入门进阶学习路线、最新paper分享、疑问解答五个方面进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业为一体的铁杆粉丝聚集区,近2000星球成员为创造更好的AI世界共同进步,知识星球入口:

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、可答疑解惑、助你高效解决问题 觉得有用,麻烦给个赞和在看~