新智元报道

新智元报道

来源:Python专栏(ID:xpchulit)

作者:上海小胖

【新智元导读】在MIT和哈佛大学合作的项目中,研究员们探索了神经网络的可信度问题,他们开发了一种可以处理数据的神经网络,不仅可以输出预测结果,还可以根据可用数据的质量,给出模型的可信赖水平。

神经网络被用的越来越多了。

无论是医疗诊断还是自动驾驶,在许多关乎人类安全与健康的重要领域,神经网络逐渐开始发挥作用。

但是这些神经网络,可信吗?

我们都知道,神经网络善于从大型、复杂的数据中识别模式,以帮助人类决策,但是它进行识别的过程却是一个黑箱。

一些AI研究者就试图揭开这一秘密,找出神经网络可信度的答案。

在一个麻省理工(MIT)和哈佛大学合作的项目中,亚历山大·阿米尼(Alexander Amini)和他的同事们就在探索这一问题,他们开发了一种可以处理数据的神经网络,不仅可以输出预测结果,还可以根据可用数据的质量,给出模型的可信赖水平。

简单来说,就是让神经网络自己对自己的结果可信度打个分,颠颠自己“几斤几两”!

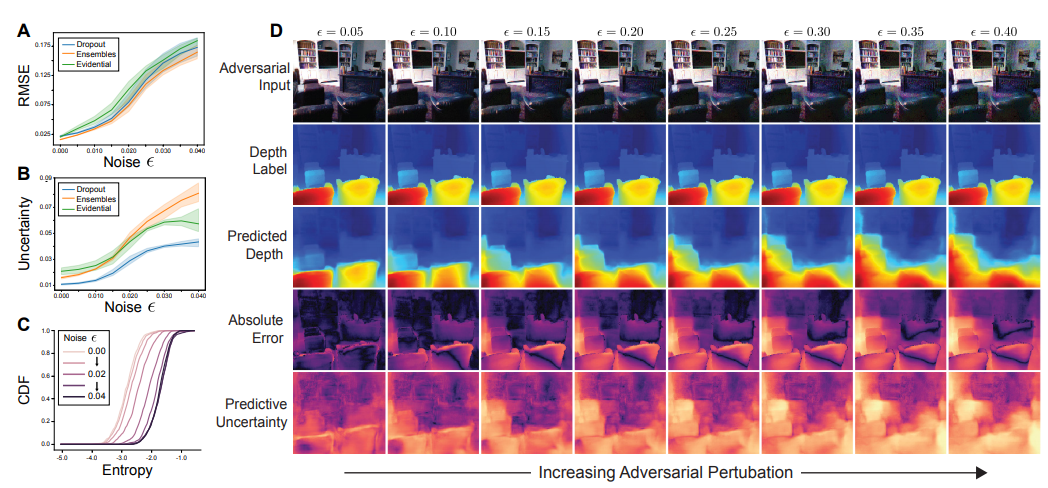

打个比方,在自动驾驶中,模型通过对各种传感器的数据进行分析,这就是“交叉路口一切正常”和“可能安全,要以防万一”的区别。

目前的神经网络不确定性评估往往成本昂贵,并且要耗费相当长的时间,但是阿米尼提出的“深度证据回归”(deep evidential regression),可以加速这一过程,并且得到更可靠的结果。

麻省理工学院计算机科学与人工智能实验室(CSAIL)DanielaRus教授团队的博士生Amini说:“我们不仅需要拥有高性能的模型,还需要理解什么时候我们不能信任这些模型。”

“这个想法很重要,适用范围很广。它可以用来评估依赖于学习模型的产品。通过对学习模型的不确定性进行估计,我们还可以了解该模型可能带来的误差,以及哪些缺失的数据可以改进该模型。”Rus说。

阿米尼将在 NeurIPS 会议上展示这项研究,Rus将与他一起赴会。

有效的不确定性

检查可信度

本文来源:公众号 @Python专栏,作者上海小胖,四大咨询TechLead,mongoDB Professional 获得者。「Python专栏」专注Python领域的各种技术:爬虫、DevOps、人工智能、Web开发等。