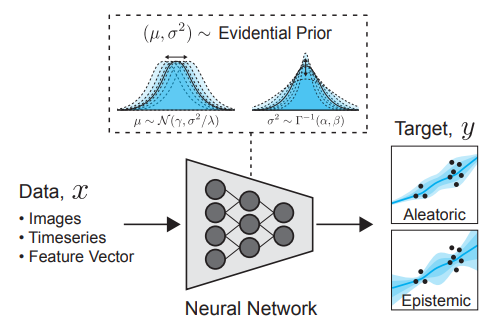

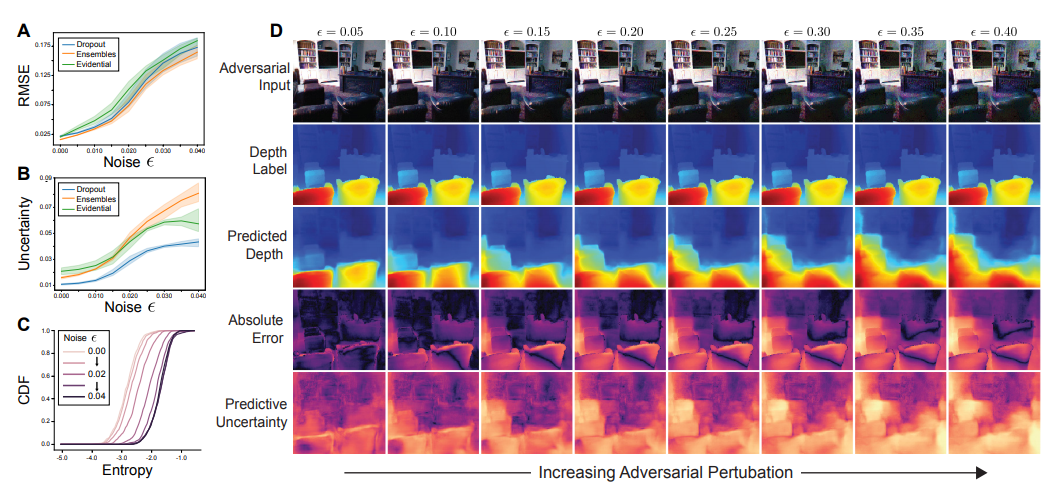

MIT、哈佛合作,这个可信度研究让神经网络认清自己“几斤几两”!

大数据文摘

共 2566字,需浏览 6分钟

· 2020-12-11

https://www.csail.mit.edu/news/neural-network-learns-when-it-should-not-be-trusted

评论

共 2566字,需浏览 6分钟

· 2020-12-11

https://www.csail.mit.edu/news/neural-network-learns-when-it-should-not-be-trusted