为什么说大模型微调是每个人都必备的核心技能?

架构之美

共 3634字,需浏览 8分钟

· 2023-11-01

▼最近直播超级多,预约保你有收获

近期直播:《基于开源 LLM 大模型的微调(Fine tuning)实战》

0 —

为什么要对 LLM 大模型进行微调(Fine tuning)?

— 1 —

如何对 LLM 大模型进行微调(Fine tuning)?

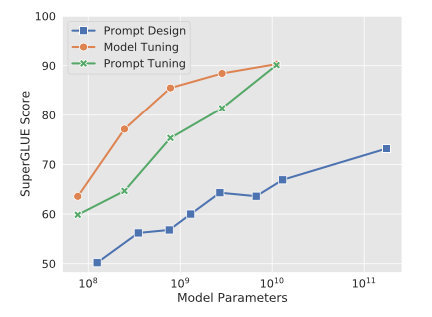

从参数规模的角度,对大模型进行微调(Fine tuning)有两条技术路线:

— 2 —

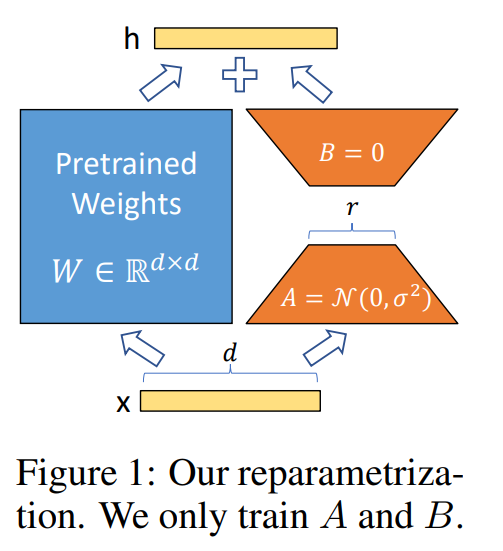

主流部分参数 PEFT 微调(Fine tuning)方案剖析

— 3—

免费超干货 LLM 大模型直播

为了帮助同学们掌握好 LLM 大模型的微调技术,本周日晚8点,我会开一场直播和同学们深度聊聊大模型的技术、分布式训练和参数高效微调,请同学点击下方按钮预约直播,咱们本周日晚8点不见不散哦~~

END

评论

万字长文总结大模型微调技能图谱

随着大模型的飞速发展,在短短一年间就有了大幅度的技术迭代更新,从LoRA、QLoRA、AdaLoRa、ZeroQuant、Flash Attention、KTO、PPO、DPO、蒸馏技术到模型增量学习、数据处理、开源模型的理解等,几乎每天都有新的发展。我们总结了算法工程师需要掌握的大模型微调技能,并

人工智能与算法学习

0

2024年,每个人都能用大模型赚钱了

自从CHATGPT腾空出世以后,影响了很多行业,也影响了很多人。 于我身边的圈子,有的利用CHATGPT做副业赚到了很多钱,有的已经习惯利用CHATGPT解决一些技术的问题,甚至有的认为GPT这种生成式模型出现,自己所写的技...

proginn1714155224

0

CodeFuse-MFTCoder多任务微调代码大模型

Codefuse-MFTCoder是一个开源的多任务代码大语言模型项目,包含代码大模型的模型、数据、训练等。项目框架项目优势多任务:一个模型同时支持多个任务,会保证多个任务之间的平衡,甚至可以泛化到新

CodeFuse-MFTCoder多任务微调代码大模型

0